Показаны записи 91 - 100 из 2065

![[pic]](https://dl.dropboxusercontent.com/s/mb2ebx30cmokwx1/55167_original.jpg?dl=0)

Темы MetaPractice (21.08.19) - 242 темы

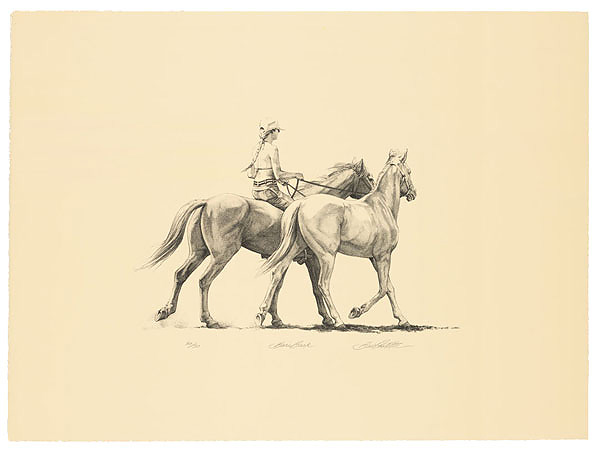

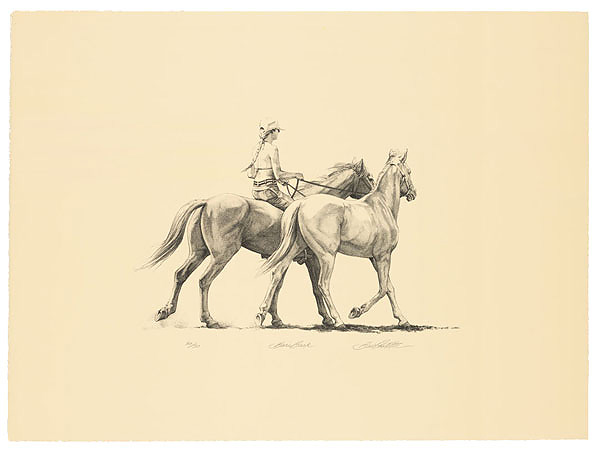

Во всем ищи более тонкие градации качества, не теряя из виду целое. И в чем вчера различал два-три качества, завтра увидишь массу новых (для себя) тонкостей. Нет мелочей - есть подробности. Эти чуть -чуть в сумме отличают Мастера от дилетанта.

Сунь Лутан

Сунь Лутан

![[pic]](http://i0.wp.com/eroskosmos.org/wp-content/uploads/2019/08/kychan-QU7EJulPh0A-unsplash.jpg?w=1100)

Медитация и действие

Медитация, выпуск 4

https://metapractice.livejournal.com/556760.html

Медитация и действие

http://eroskosmos.org/meditation-and-action/?fbclid=IwAR1o3CHMl0YK7u2gvep2_XAeaeVWztF81PaFYZCxUOJTAZQNNj-ma-eLCOo

Каково место действия в созерцательной практике? Это один из ключевых вопросов, без понимания которого успешная практика становится либо крайне ограниченной, либо вообще невозможной. Попробуем разобраться.

Прежде всего нужно понять, что понимается под действием. В этом вопросе наш язык обманчив, поскольку обычно действия выражаются такой грамматической категорией, как глагол, но не всегда глагол обозначает действие. Например, когда я встаю и иду, то «идти» обозначает действие, а вот когда на улице идёт дождь или по телевизору идёт шоу, то «идти» обозначает не вовсе действие, а некоторый безличный процесс и в таком случае слово «идти» — метафора, основанная на пространственно-временных отношениях. Применительно к психическим событиям, например, «подумать» — это действие, а «разгневаться» нет.

Медитация и действие

http://eroskosmos.org/meditation-and-action/?fbclid=IwAR1o3CHMl0YK7u2gvep2_XAeaeVWztF81PaFYZCxUOJTAZQNNj-ma-eLCOo

Каково место действия в созерцательной практике? Это один из ключевых вопросов, без понимания которого успешная практика становится либо крайне ограниченной, либо вообще невозможной. Попробуем разобраться.

Прежде всего нужно понять, что понимается под действием. В этом вопросе наш язык обманчив, поскольку обычно действия выражаются такой грамматической категорией, как глагол, но не всегда глагол обозначает действие. Например, когда я встаю и иду, то «идти» обозначает действие, а вот когда на улице идёт дождь или по телевизору идёт шоу, то «идти» обозначает не вовсе действие, а некоторый безличный процесс и в таком случае слово «идти» — метафора, основанная на пространственно-временных отношениях. Применительно к психическим событиям, например, «подумать» — это действие, а «разгневаться» нет.

![[pic]](https://ic.pics.livejournal.com/meta_eugzol/27643619/22888/22888_600.jpg)

Фромм и ценности

Ценностные Иерархии, выпуск 64

https://metapractice.livejournal.com/589732.html

I. С точки зрения нормативного гуманизма мы должны прийти к иному пониманию душевного здоровья. Та самая личность, которая с позиций отчуждённого общества считается здоровой, с гуманистической точки зрения предстаёт как самая больная, хотя и не в плане индивидуального заболевания, а в смысле социально заданной ущербности.

I. С точки зрения нормативного гуманизма мы должны прийти к иному пониманию душевного здоровья. Та самая личность, которая с позиций отчуждённого общества считается здоровой, с гуманистической точки зрения предстаёт как самая больная, хотя и не в плане индивидуального заболевания, а в смысле социально заданной ущербности.

![[pic]](https://ic.pics.livejournal.com/meta_eugzol/27643619/22324/22324_600.jpg)

ЦИ в философии

Ценностные Иерархии, выпуск 63

https://metapractice.livejournal.com/585483.html

Ценностная иерархия - субординация ценностей в рамках какой-либо системы ценностей. Ценности всегда нам даны в порядках их взаимосвязи, в составе ценностных систем при помощи актов предпочтения. В аксиологии ценности имеют различные величины (магнитуды). Эти величины могут характеризовать ценности со стороны "высоты", "силы", "полноты", "подлинности" и т.п.

http://www.lomonosov-fund.ru/enc/ru/encyclopedia:0127736:article

Наибольшую известность приобрели критерии высоты ценности М. Шелера. Он исходил из идеи, что система ценностей предполагает иерархию. Для каждого из нас одна ценность является более значимой, нежели другая. При этом на значимость ценности могут влиять различные обстоятельства, т.к. у разных людей ценностные приоритеты часто не совпадают. Тем не менее, существует единый механизм постижения иерархии ценностей несмотря на многообразие их содержания. Иерархия ценностей постигается в особом акте познания - акте предпочтения (или пренебрежения). Значимость той или иной ценности задается самим актом предпочтения, и никогда до него. Важность той или иной ценности постигается каждый раз заново в акте предпочтения. Высота, занимаемая той или иной ценностью в иерархии конкретного человека, не определяется его желанием, выбором или стремлением.

Ценностная иерархия - субординация ценностей в рамках какой-либо системы ценностей. Ценности всегда нам даны в порядках их взаимосвязи, в составе ценностных систем при помощи актов предпочтения. В аксиологии ценности имеют различные величины (магнитуды). Эти величины могут характеризовать ценности со стороны "высоты", "силы", "полноты", "подлинности" и т.п.

http://www.lomonosov-fund.ru/enc/ru/encyclopedia:0127736:article

Наибольшую известность приобрели критерии высоты ценности М. Шелера. Он исходил из идеи, что система ценностей предполагает иерархию. Для каждого из нас одна ценность является более значимой, нежели другая. При этом на значимость ценности могут влиять различные обстоятельства, т.к. у разных людей ценностные приоритеты часто не совпадают. Тем не менее, существует единый механизм постижения иерархии ценностей несмотря на многообразие их содержания. Иерархия ценностей постигается в особом акте познания - акте предпочтения (или пренебрежения). Значимость той или иной ценности задается самим актом предпочтения, и никогда до него. Важность той или иной ценности постигается каждый раз заново в акте предпочтения. Высота, занимаемая той или иной ценностью в иерархии конкретного человека, не определяется его желанием, выбором или стремлением.

![[pic]](https://ic.pics.livejournal.com/meta_eugzol/27643619/22232/22232_300.png)

Сознание = процесс квантования

Сознание, выпуск 34

https://metapractice.livejournal.com/588128.html

Сознание есть процесс квантования сенсорики по времени – при этом отдельным моментам t времени присваиваются одни и те же значения сенсорики. (Аналогично можно определить и "симультанное" сознание.)

Процесс сознания есть развёрнутая/обширная «онто-система». Но каждая/все элементы онто-системы будут подобны первичному квантованию сенсорики.

Сознание есть процесс квантования сенсорики по времени – при этом отдельным моментам t времени присваиваются одни и те же значения сенсорики. (Аналогично можно определить и "симультанное" сознание.)

Процесс сознания есть развёрнутая/обширная «онто-система». Но каждая/все элементы онто-системы будут подобны первичному квантованию сенсорики.

![[pic]](https://ic.pics.livejournal.com/meta_eugzol/27643619/21767/21767_600.jpg)

Н, Л, П

Определения для моделирования, выпуск 18

https://metapractice.livejournal.com/583353.html

Нейрология:

Нейрология:

- Связь активности нервной системы (НС), включая головной мозг (ГМ) и внешней активности (сигналов и поведения)

- Ключевой поведенческий паттерн

- Сигнальные комплексы

- «Нейрологические метафоры»

- Технические метафоры (ДХЕ) в роли нейрологических метафор

![[pic]](https://ic.pics.livejournal.com/meta_eugzol/27643619/21629/21629_300.png)

Калибровка эффективности психотерапии

Эффективность Моделирующей Психотерапии, выпуск 42

https://metapractice.livejournal.com/588336.html

Калибровку эффективности психотерапии (психо-консультирования, коучинга и т.д.) предлагается делать в трёх системах оценок:

I. Связанных с субъектом

II. Связанных с оператором или заинтересованным наблюдателем

III. Связанных с независимым наблюдателем

Калибровку эффективности психотерапии (психо-консультирования, коучинга и т.д.) предлагается делать в трёх системах оценок:

I. Связанных с субъектом

II. Связанных с оператором или заинтересованным наблюдателем

III. Связанных с независимым наблюдателем

Страх к математике

Образование -обучение, выпуск 12

https://metapractice.livejournal.com/587190.html

Горчичное зерно изменений

И вот, в итоге, всегда так оказывается, что типа математика нелюбима, потому как существует некое "отрицание", например, самих ЦИФР ! Ага, идиосинкразия на цифры. Или на их написание. Или еще на что ПРИМИТИВНОЕ связанное с цифирью (а потом и с формулами, вычислениями и всеми другими "производными"от идиосинкразии на цифры видами деятельности).

https://metapractice.livejournal.com/587190.html

Как сильно вы ненавидите математические задачи? А деление в столбик? Дроби? Мат.анализ?

У множества людей одно лишь упоминание подобных вычислений вызывает ужас и даже, в некотором роде, боль. Исследование![]() психологов Иана Лайона (Ian Lyon) и Шона Билока (Sian Beilock) показало, что это вовсе не преувеличение: нелюбовь к математике у некоторых людей обусловлена тем, что ощущения от необходимости работы с числами сопоставимы с физической болью. Людям, обладающим высокой степенью математической тревоги (high levels of mathematics-anxiety — HMAs), она причиняет физические страдания. https://habr.com/post/157727/

психологов Иана Лайона (Ian Lyon) и Шона Билока (Sian Beilock) показало, что это вовсе не преувеличение: нелюбовь к математике у некоторых людей обусловлена тем, что ощущения от необходимости работы с числами сопоставимы с физической болью. Людям, обладающим высокой степенью математической тревоги (high levels of mathematics-anxiety — HMAs), она причиняет физические страдания. https://habr.com/post/157727/

Горчичное зерно изменений

И вот, в итоге, всегда так оказывается, что типа математика нелюбима, потому как существует некое "отрицание", например, самих ЦИФР ! Ага, идиосинкразия на цифры. Или на их написание. Или еще на что ПРИМИТИВНОЕ связанное с цифирью (а потом и с формулами, вычислениями и всеми другими "производными"от идиосинкразии на цифры видами деятельности).

https://metapractice.livejournal.com/587190.html

Как сильно вы ненавидите математические задачи? А деление в столбик? Дроби? Мат.анализ?

У множества людей одно лишь упоминание подобных вычислений вызывает ужас и даже, в некотором роде, боль. Исследование

![[pic]](https://ic.pics.livejournal.com/metanymous/1177339/167821/167821_600.jpg)

Две методологии оценки эффективности психотерапии

Эффективность Моделирующей Психотерапии, выпуск 41

https://metapractice.livejournal.com/583635.html

ДВЕ КОНФЛИКТУЮЩИЕ МЕТОДОЛОГИИ В ИССЛЕДОВАНИЯХ ПСИХОТЕРАПИИ И ЕЕ ЭФФЕКТИВНОСТИ: ПОИСК ТРЕТЬЕГО ПУТИ. ЧАСТЬ I

ХОЛМОГОРОВА АЛЛА БОРИСОВНА1

1 ФГУ "Московский НИИ психиатрии Росздрава"

МОСКОВСКИЙ ПСИХОТЕРАПЕВТИЧЕСКИЙ ЖУРНАЛ

Издательство: Московский государственный психолого-педагогический университет (Москва)

ISSN: 0135-2652

КЛЮЧЕВЫЕ СЛОВА: ЭФФЕКТИВНОСТЬ ПСИХОТЕРАПИИ, EFFICIENCY OF PSYCHOTHERAPY, ТЕОРИЯ ПСИХОТЕРАПИИ, PSYCHOTHERAPY THEORY, НЕКЛАССИЧЕСКАЯ МЕТОДОЛОГИЯ, NONCLASSICAL METHODOLOGY, РАССТРОЙСТВА АФФЕКТИВНОГО СПЕКТРА, FRUSTRATION OF AN AFFECTIVE SPECTRUM, ИССЛЕДОВАНИЯ В ПСИХОТЕРАПИИ, RESEARCH IN PSYCHOTHERAPY

АННОТАЦИЯ: На основе концептуальной схемы анализа различных подходов, предложенной Н.Г. Алексеевым, вычленяются моделирующие представления о психотерапии герменевтического и позитивистского подходов к исследованию психотерапии и оценке ее эффективности, вычленяются теоретико-методологические принципы исследования в рамках этих оппозиционных подходов и описываются исследовательские правила и процедуры, в которых эти принципы реализуются. Дается критический анализ позитивистской методологии, доминирующей на данном этапе научного поиска. В опоре на разработки отечественных методологов вводится моделирующее представление о психотерапии как науке неклассического типа. На основе этого моделирующего представления, а также результатов многолетних исследований расстройств аффективного спектра и опыта психотерапевтической работы с этими расстройствами, предлагается модель интегративной психотерапии расстройств аффективного спектра, позволяющая с позиций неклассической науки разрабатывать принципы и процедуры исследований процесса психотерапии и ее эффективности.

https://elibrary.ru/item.asp?id=12993403

ДВЕ КОНФЛИКТУЮЩИЕ МЕТОДОЛОГИИ В ИССЛЕДОВАНИЯХ ПСИХОТЕРАПИИ И ЕЕ ЭФФЕКТИВНОСТИ: ПОИСК ТРЕТЬЕГО ПУТИ. ЧАСТЬ I

ХОЛМОГОРОВА АЛЛА БОРИСОВНА1

1 ФГУ "Московский НИИ психиатрии Росздрава"

МОСКОВСКИЙ ПСИХОТЕРАПЕВТИЧЕСКИЙ ЖУРНАЛ

Издательство: Московский государственный психолого-педагогический университет (Москва)

ISSN: 0135-2652

КЛЮЧЕВЫЕ СЛОВА: ЭФФЕКТИВНОСТЬ ПСИХОТЕРАПИИ, EFFICIENCY OF PSYCHOTHERAPY, ТЕОРИЯ ПСИХОТЕРАПИИ, PSYCHOTHERAPY THEORY, НЕКЛАССИЧЕСКАЯ МЕТОДОЛОГИЯ, NONCLASSICAL METHODOLOGY, РАССТРОЙСТВА АФФЕКТИВНОГО СПЕКТРА, FRUSTRATION OF AN AFFECTIVE SPECTRUM, ИССЛЕДОВАНИЯ В ПСИХОТЕРАПИИ, RESEARCH IN PSYCHOTHERAPY

АННОТАЦИЯ: На основе концептуальной схемы анализа различных подходов, предложенной Н.Г. Алексеевым, вычленяются моделирующие представления о психотерапии герменевтического и позитивистского подходов к исследованию психотерапии и оценке ее эффективности, вычленяются теоретико-методологические принципы исследования в рамках этих оппозиционных подходов и описываются исследовательские правила и процедуры, в которых эти принципы реализуются. Дается критический анализ позитивистской методологии, доминирующей на данном этапе научного поиска. В опоре на разработки отечественных методологов вводится моделирующее представление о психотерапии как науке неклассического типа. На основе этого моделирующего представления, а также результатов многолетних исследований расстройств аффективного спектра и опыта психотерапевтической работы с этими расстройствами, предлагается модель интегративной психотерапии расстройств аффективного спектра, позволяющая с позиций неклассической науки разрабатывать принципы и процедуры исследований процесса психотерапии и ее эффективности.

https://elibrary.ru/item.asp?id=12993403

![[pic]](https://ic.pics.livejournal.com/metanymous/1177339/167518/167518_300.jpg)

Дуальность Искусственного Интеллекта

Сводная тема, выпуск 53

https://metapractice.livejournal.com/587759.html

St. Neuronet (18) Искусственная Интуиция

https://metapractice.livejournal.com/573743.html

Подсознательное мышление (4) Интуитивное мышление

https://metapractice.livejournal.com/584794.html

Эпистемология моделирования (4) Моделирование ЧА vs ИИ

https://metapractice.livejournal.com/544138.html

Онтология высших ментальных процессов (2) Ментальные процессы ЧА vs ИИ

https://metapractice.livejournal.com/565864.html

Ментальные инструменты (2) Ментальные инструменты ЧА vs ИИ

https://metapractice.livejournal.com/567523.html

Подсознание (16) Подсознание ЧА vs ИИ

https://metapractice.livejournal.com/584794.html

Сознание (33) «Сознание» ИИ vs ЧА

https://metapractice.livejournal.com/584794.html

Как искусственный интеллект уперся лбом в стенку/ в искусственную интуицию

Искусственному интеллекту уже более 60 лет – он старше многих из нас. И все эти 60 лет накануне первого апреля в своих редакциях собирались журналисты, ставили на стол бутылку водки и придумывали очередную фантазию о чудо-роботах или ужасном апокалипсисе с участием ИИ. Потом первоапрельские шутки на полном серьезе подхватывали маркетологи и пиарщики – в итоге за 60 лет у человечества накопилось много забавных иллюзий и мифов об умных роботах и коварных скайнетах.

Когда-нибудь этот пузырь фантазий должен был столкнуться с объективной реальностью – и это произошло! В декабре 2017 года ряд уважаемых в отрасли ИИ экспертов (среди них руководитель Microsoft Research Кейт Кроуфорд и основатель Open Research в Google Мередит Уиттакер) выступили с настоятельной рекомендацией государственным учреждениям США воздерживаться от использования искусственного интеллекта в системах, связанных с принятием ответственных решений. Предупреждение объяснялось «неопределенно высокими рисками, недопустимыми в вопросах принятия ответственных решений» и касалось правительства, обороны, уголовного правосудия, здравоохранения, социального обеспечения, образования и подбора/оценки кадров.

Первыми еще в 2016 году подняли тревогу военные ученые из DARPA, управления по перспективным исследовательским проектам Пентагона. Они в частности заявили: «Мы не понимаем:

1) Почему машина выбрала или предложила именно такое решение, а не другое?

2) А что было бы, если бы было принято иное решение?

3) Как понять, было ли это лучшее решение?

4) Насколько можно доверять конкретному выбору решения машиной?

5) И главное – как нам исправить ситуацию, если принятое машиной решение окажется ошибочным?»

Последний пункт с точки зрения будущего развития ИИ-отрасли действительно главный: такая исключительно важная для совершенствования специалиста-человека опция как «работа над ошибками» искусственному интеллекту недоступна.

Проблема называется «черный ящик искусственного интеллекта» — ее суть в том, что мотивация и логика принятия машиной того или иного решения непонятна даже самим разработчикам. И как решили эксперты, пока эта проблема не решена, системы ИИ становятся все опасней.

St. Neuronet (18) Искусственная Интуиция

https://metapractice.livejournal.com/573743.html

Подсознательное мышление (4) Интуитивное мышление

https://metapractice.livejournal.com/584794.html

Эпистемология моделирования (4) Моделирование ЧА vs ИИ

https://metapractice.livejournal.com/544138.html

Онтология высших ментальных процессов (2) Ментальные процессы ЧА vs ИИ

https://metapractice.livejournal.com/565864.html

Ментальные инструменты (2) Ментальные инструменты ЧА vs ИИ

https://metapractice.livejournal.com/567523.html

Подсознание (16) Подсознание ЧА vs ИИ

https://metapractice.livejournal.com/584794.html

Сознание (33) «Сознание» ИИ vs ЧА

https://metapractice.livejournal.com/584794.html

Как искусственный интеллект уперся лбом в стенку/ в искусственную интуицию

Искусственному интеллекту уже более 60 лет – он старше многих из нас. И все эти 60 лет накануне первого апреля в своих редакциях собирались журналисты, ставили на стол бутылку водки и придумывали очередную фантазию о чудо-роботах или ужасном апокалипсисе с участием ИИ. Потом первоапрельские шутки на полном серьезе подхватывали маркетологи и пиарщики – в итоге за 60 лет у человечества накопилось много забавных иллюзий и мифов об умных роботах и коварных скайнетах.

Когда-нибудь этот пузырь фантазий должен был столкнуться с объективной реальностью – и это произошло! В декабре 2017 года ряд уважаемых в отрасли ИИ экспертов (среди них руководитель Microsoft Research Кейт Кроуфорд и основатель Open Research в Google Мередит Уиттакер) выступили с настоятельной рекомендацией государственным учреждениям США воздерживаться от использования искусственного интеллекта в системах, связанных с принятием ответственных решений. Предупреждение объяснялось «неопределенно высокими рисками, недопустимыми в вопросах принятия ответственных решений» и касалось правительства, обороны, уголовного правосудия, здравоохранения, социального обеспечения, образования и подбора/оценки кадров.

Первыми еще в 2016 году подняли тревогу военные ученые из DARPA, управления по перспективным исследовательским проектам Пентагона. Они в частности заявили: «Мы не понимаем:

1) Почему машина выбрала или предложила именно такое решение, а не другое?

2) А что было бы, если бы было принято иное решение?

3) Как понять, было ли это лучшее решение?

4) Насколько можно доверять конкретному выбору решения машиной?

5) И главное – как нам исправить ситуацию, если принятое машиной решение окажется ошибочным?»

Последний пункт с точки зрения будущего развития ИИ-отрасли действительно главный: такая исключительно важная для совершенствования специалиста-человека опция как «работа над ошибками» искусственному интеллекту недоступна.

Проблема называется «черный ящик искусственного интеллекта» — ее суть в том, что мотивация и логика принятия машиной того или иного решения непонятна даже самим разработчикам. И как решили эксперты, пока эта проблема не решена, системы ИИ становятся все опасней.

Дочитали до конца.